Er gaat momenteel een virale video rond waarin de president van de Verenigde Staten, Donald Trump, achter acties van India tegen Pakistan zou staan. In die video spreekt Trump zich uit voor vergaande acties, waarbij Pakistan ‘vernietigd moet worden’. Daarbij is een terroristische aanslag in Pahalgam, Kashmir te zien. Maar die video is nep en bewerkt door kunstmatige intelligentie.

Gevaarlijke video

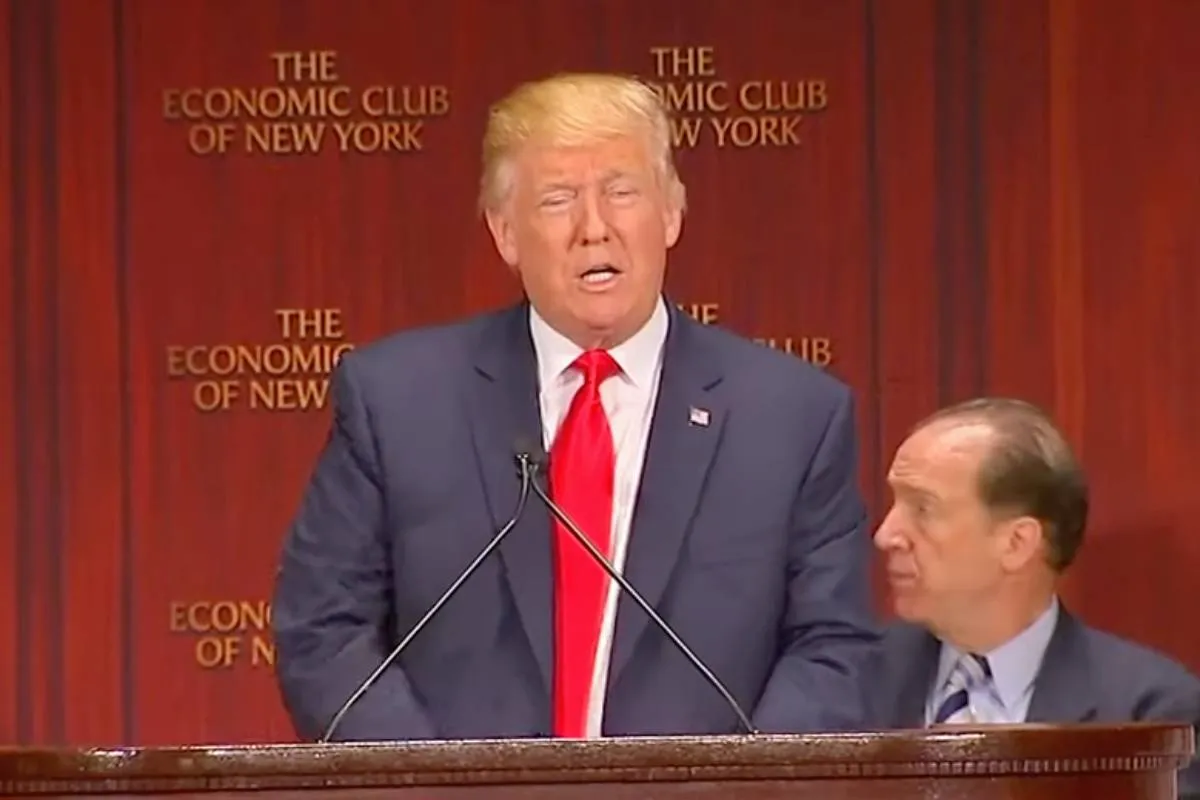

De video laat goed zien hoe gevaarlijk kunstmatige intelligentie kan zijn. De video is bewerkt met een zogenaamde voice-clone. Dat betekent dat iemand de stem van de Amerikaanse president heeft gekloond en getraind met AI, waardoor kunstmatige intelligentie kan klinken als Donald Trump. De spraak komt oorspronkelijk uit een filmpje uit 2016. De beelden die zijn gebruikt, komen ook uit dat filmpje.

Momenteel zijn er oplopende spanningen tussen India en Pakistan. Dus gaat er nu een filmpje rond waarin te zien is dat Donald Trump achter India zou staan en wil dat Pakistan hard wordt aangepakt. De video is gemaakt naar aanleiding van een terroristische aanslag in Pahalgam, waarbij 28 burgers omkwamen.

Viraal, maar nep

In de video zou Trump zeggen: “Als Pakistan India aanvalt, kijk ik niet toe. Dan vernietig ik Pakistan. Modi (red: de president van India) is mijn vriend en ik hou van de bevolking van India.” Maar dat heeft Trump nooit gezegd en de video is volledig het werk van kunstmatige intelligentie.

Het online magazine BOOM zocht uit waar de video vandaan kwam. Daarbij blijkt dat het gaat om een video uit 2016, waarbij Trump spreekt tijdens een vergadering van economen in New York. De video stamt van 16 september 2016. Hij sprak daar toen, om zich verkiesbaar te stellen voor de presidentsverkiezingen in Amerika. Deze originele video werd onder meer uitgezonden door CNN. Trump had het toen over hoe hij de Amerikaanse economie er bovenop wilde helpen.

Deepfake

Trump heeft met geen woord gesproken over India of Pakistan. Dit is dus het werk van kunstmatige intelligentie. Het vervalsen van spraak of beeld noemen we een deepfake. Deepfakes komen steeds vaker voor en worden gebruikt om nepnieuws, zoals deze, mee te verspreiden. Dat kan gevaarlijk zijn, omdat dit tot politieke spanningen in de echte wereld kan leiden.

Lees ook

POPULAIR NIEUWS

Beelden tuin klaarmaken voor barbecue in 5 uur gaat viraal

Duikinstructeur vertoont ongewenst gedrag

‘American Pie’ ster Shannon Elizabeth trekt in een week meer een miljoen binnen met haar fans op AlleenFans

Roel leeft ervoor: de dag na Koningsdag Dixi’s legen

Nieuw Nederlands record touwtjespringen voor Robin Klaver

Marokkaanse bruiloft hot en happening, hier kun je het boeken

Loading